Un equipo de investigadores del Institute for Basic Science (IBS), la Yonsei University, y la Max Planck Institute ha desarrollado una nueva técnica de inteligencia artificial (IA) que aproxima la visión artificial a la forma en que el cerebro humano procesa la información visual. Conocido como Lp-Convolution, este método mejora la precisión y eficacia de los sistemas de reconocimiento de imágenes al tiempo que reduce las exigencias computacionales de los modelos tradicionales de IA.

Acortando distancias entre las CNN y el cerebro humano

El cerebro humano destaca en la identificación rápida de características importantes en escenas visuales complejas, un nivel de eficacia que los sistemas de IA convencionales han tenido dificultades para alcanzar. Las Convolutional Neural Networks (CNNs) o redes neuronales convolucionales, los modelos más utilizados para el reconocimiento de imágenes, las analizan utilizando pequeños filtros fijos de forma cuadrada. Aunque son eficaces hasta cierto punto, este diseño limita su capacidad para detectar patrones más amplios en datos fragmentados o variables.

Más recientemente, los Vision Transformers (ViT) han superado a las CNN al evaluar imágenes enteras simultáneamente. Sin embargo, su éxito tiene un coste: requieren una enorme potencia de cálculo y vastos conjuntos de datos, lo que los hace menos viables para su despliegue práctico a gran escala.

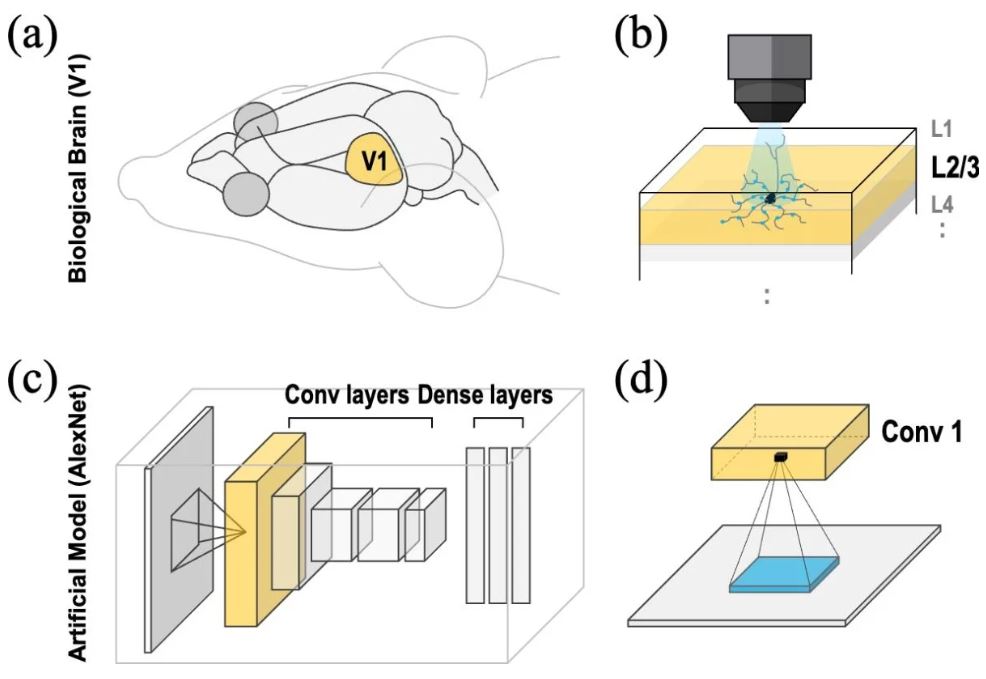

Inspirándose en la forma en que la corteza visual del cerebro procesa la información de forma selectiva a través de conexiones circulares dispersas, el equipo de investigación buscó un término medio: ¿Podría un enfoque similar al del cerebro hacer que las CNN fueran eficientes y potentes?

En la corteza visual del cerebro real, las neuronas están conectadas de forma amplia y fluida alrededor de un punto central, y la intensidad de la conexión varía gradualmente con la distancia (a, b). Esta conectividad espacial sigue una curva en forma de campana conocida como «distribución de Gauss», lo que permite al cerebro integrar la información visual no sólo del centro, sino también de las zonas circundantes. En cambio, las redes neuronales convolucionales (CNN) tradicionales procesan la información haciendo que las neuronas se centren en una región rectangular fija (por ejemplo, 3×3, 5×5, etc.) (c, d). Los filtros de las CNN se desplazan por una imagen a intervalos regulares, extrayendo la información de manera uniforme, lo que limita su capacidad para captar relaciones entre elementos visuales distantes o responder selectivamente en función de su importancia. Crédito de imagen: Institute for Basic Science

Evolución LP: Una forma más inteligente de ver

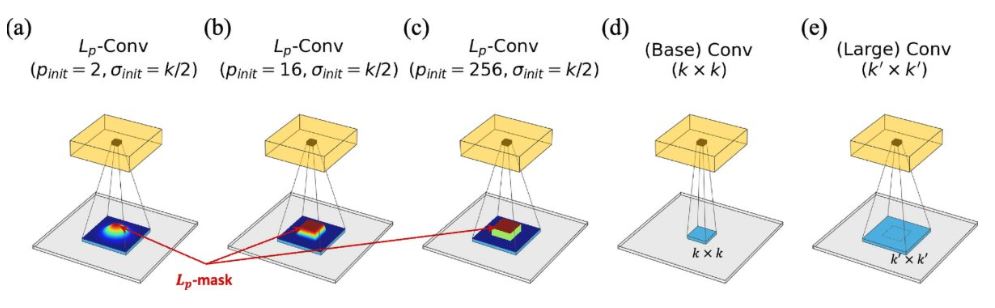

Para responder a esta pregunta, el equipo desarrolló la Lp-Convolution, un novedoso método que utiliza una distribución normal multivariante p-generalizada (MPND) para remodelar los filtros de las CNN de forma dinámica. A diferencia de las CNN tradicionales, que utilizan filtros cuadrados fijos, la Lp-Convolution permite a los modelos de IA adaptar la forma de sus filtros, estirándolos horizontal o verticalmente en función de la tarea, de forma muy parecida a cómo el cerebro humano se centra selectivamente en los detalles relevantes.

Este avance resuelve un problema de larga data en la investigación de la IA, conocido como el problema de los núcleos grandes. El simple aumento del tamaño de los filtros en las CNN (por ejemplo, utilizando núcleos de 7×7 o más) no suele mejorar el rendimiento, a pesar de añadir más parámetros. La Lp-Convolution supera esta limitación introduciendo patrones de conectividad flexibles y de inspiración biológica.

Rendimiento en el mundo real: Inteligencia artificial más sólida, inteligente y robusta

En pruebas realizadas con conjuntos de datos estándar de clasificación de imágenes (CIFAR-100, TinyImageNet), Lp-Convolution mejoró significativamente la precisión tanto de modelos clásicos como AlexNet como de arquitecturas modernas como RepLKNet. El método también demostró ser muy robusto frente a datos corruptos, un reto importante en las aplicaciones de IA del mundo real.

Además, los investigadores descubrieron que cuando las máscaras Lp utilizadas en su método se asemejaban a una distribución gaussiana, los patrones de procesamiento interno de la IA se asemejaban mucho a la actividad neuronal biológica, como confirmaron las comparaciones con datos del cerebro de ratones.

El Dr. C. Justin LEE, Director del Center for Cognition and Sociality del Institute for Basic Science, dijo en un comunicado:

“Los humanos detectamos rápidamente lo que importa en una escena abarrotada. Nuestra LP-Convolution imita esta capacidad, permitiendo a la IA centrarse con flexibilidad en las partes más relevantes de una imagen, igual que hace el cerebro”.

El cerebro procesa la información visual mediante una estructura de conectividad de forma gaussiana que se extiende gradualmente desde el centro hacia fuera, integrando con flexibilidad una amplia gama de información. En cambio, las CNN tradicionales se enfrentan a problemas en los que la ampliación del tamaño del filtro diluye la información o reduce la precisión (d, e). Para superar estas limitaciones estructurales, el equipo de investigación desarrolló la Lp-Convolution, inspirada en la conectividad del cerebro (a-c). Este diseño distribuye espacialmente los pesos para preservar la información clave incluso en campos receptivos extensos, lo que resuelve eficazmente las deficiencias de las CNN convencionales. Crédito de imagen: Institute for Basic Science

Impacto y aplicaciones futuras

A diferencia de los esfuerzos anteriores, que se basaban en filtros pequeños y rígidos o requerían transformadores que consumían muchos recursos, la Lp-Convolution ofrece una alternativa práctica y eficiente. Esta innovación podría revolucionar campos como:

- Conducción autónoma, en la que la IA debe detectar rápidamente los obstáculos en tiempo real.

- Imágenes médicas, que mejoran los diagnósticos basados en IA al resaltar detalles sutiles.

- Robótica, permitiendo una visión artificial más inteligente y adaptable en condiciones cambiantes.

El Director C. Justin Lee dijo en un comunicado:

“Este trabajo es una poderosa contribución tanto a la IA como a la neurociencia. Al alinear la IA más estrechamente con el cerebro, hemos desbloqueado un nuevo potencial para las CNN, haciéndolas más inteligentes, más adaptables y más biológicamente realistas”.

De cara al futuro, el equipo tiene previsto perfeccionar aún más esta tecnología, explorando sus aplicaciones en tareas de razonamiento complejas como la resolución de rompecabezas (por ejemplo, Sudoku) y el procesamiento de imágenes en tiempo real.

El estudio se presentará en la International Conference on Learning Representations (ICLR) 2025, y el equipo de investigación ha hecho públicos su código y sus modelos: https://github.com/jeakwon/lpconv/.

Referencias: openreview

¿Te gustó este contenido? Te invito a compartirlo con tus amigos. Síguenos en nuestra Página de Facebook, para recibir a diario nuestras noticias. También puedes unirte a nuestro Grupo Oficial y a nuestra comunidad en Telegram. Y si crees que hacemos un buen trabajo, considera apoyarnos.

Por: CodigoOculto.com

Crédito imagen de portada: depositphotos.com

0 comentarios